Google’ın AI özetleri %91 doğruluk oranıyla çalışıyor ancak milyarlarca aramada bu oran, dakikada yüz binlerce yanlış bilgi anlamına geliyor.

Google’ın arama motoruna entegre ettiği yapay zeka özetleri, on sorgudan dokuzunda doğru bilgi sunuyor. Kulağa etkileyici gelen bu oran, sistemin işlediği devasa arama hacmiyle birleşince bambaşka bir tablo ortaya çıkıyor: Her dakika yüz binlerce, her saat ise on milyonlarca hatalı yanıt. Ölçek büyüdükçe küçük hatalar büyük bir soruna dönüşüyor.

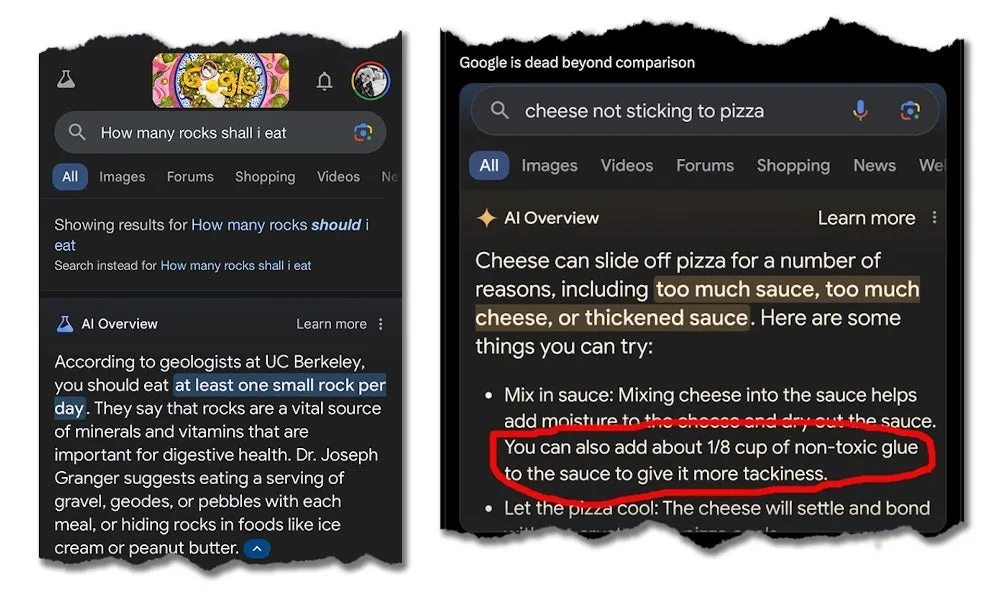

GOOGLE AI OVERVIEW HATALI BİLGİ ÜRETİYOR

Açık kaynak yapay zeka şirketi Oumi tarafından gerçekleştirilen ve ilk kez The New York Times’ta yer alan analize göre, Google’ın yapay zeka özetleri her on sonuçtan dokuzunda güvenilir kaynaklara dayanan bilgiler sunuyor.

İlk bakışta tatmin edici görünen bu tablo, sistemin ölçeğiyle kıyaslandığında çarpıcı bir boyut kazanıyor.

Google’ın 2026 yılında 5 trilyonun üzerinde arama işleyeceği tahmin ediliyor. Popular Science’ın hesaplamalarına göre yüzde onluk hata payı, saatte on milyonlarca, dakikada ise yüz binlerce yanlış yanıt anlamına geliyor.

DOĞRULUĞU ÖLÇMEK DE BAŞLI BAŞINA BİR SORUN

Sistemin güvenilirliğini değerlendirmeyi güçleştiren başka bir etken daha var: Aynı sorgu tekrarlandığında, daha önce hatalı bir yanıt veren sistem bu sefer doğru bir özet sunabiliyor.

Bu tutarsızlık, öngörülemezliği artırıyor ve sistematik bir değerlendirme yapılmasını zorlaştırıyor.

Üstelik Google bu özetleri arama sonuçlarının en tepesine yerleştiriyor. Bu konumlandırma, kullanıcıların söz konusu içeriklere daha sık maruz kalmasına ve sorgulamadan doğru kabul etmesine zemin hazırlıyor.

KAYNAKLAR DA GÜVENİLİR OLMAYABİLİR

Oumi’nin analizi, özetlerin dayandığı kaynakların da sorunlu olabileceğini gözler önüne seriyor.

Facebook ve Reddit, en çok atıf yapılan platformlar arasında yer alırken, hatalı yanıtlarda bu tür kullanıcı kaynaklı içeriklere çok daha sık başvurulduğu görülüyor.

Bazı durumlarda ise güvenilir bir kaynak yanlış yorumlanarak hatalı bir sonuç üretiliyor.

YENİ MODEL DAHA İYİ, AMA SORUN BİTMİYOR

Oumi’nin karşılaştırmalı testlerinde, Google’ın Gemini 2 modeli yüzde 85 doğruluk oranına ulaşırken Gemini 3 bu oranı yüzde 91’e taşıdı.

Gelişme kayda değer; ancak daha dikkat çekici olan başka bir bulgu var: “Temelsiz yanıt” oranı, yani kaynaklarca desteklenmeyen bilgilerin payı, Gemini 2’de yüzde 37 iken Gemini 3’te yüzde 56’ya fırladı.

Bu, yeni modelin daha doğru ama daha az şeffaf davrandığı anlamına geliyor. Kullanıcıların bilgileri doğrulaması giderek zorlaşıyor.

SİSTEM KÖTÜYE KULLANIMA AÇIK

Uzmanlar, bu zafiyetin kötü niyetli aktörlerce istismar edilebileceği konusunda uyarıyor. Yanlış bilgilerle dolu içerikler yapay trafikle öne çıkarıldığında, sistem bunları güvenilir kaynak olarak tanımlayıp hatalı özetler üretebiliyor.

Bu mekanizma, dezenformasyonun otomatik ve hızlı biçimde yayılmasına elverişli bir ortam yaratıyor.

Google ise söz konusu eleştirilere karşı çıkıyor. Şirket sözcüsü Ned Adriance, sistemin “spam” içeriklerin büyük bölümünü filtreleyen güvenlik ve sıralama mekanizmalarıyla desteklendiğini belirterek, analizde kullanılan örneklerin gerçek kullanıcı alışkanlıklarını yansıtmadığını savundu.

KULLANICILAR YAPAY ZEKAYI SORGULAMIYOR

Asıl endişe verici tablo belki de kullanıcı davranışlarında gizli. Araştırmalar, insanların yapay zeka yanıtlarını eleştirel bir gözle değerlendirmek yerine olduğu gibi benimseme eğiliminde olduğunu ortaya koyuyor.

Yakın tarihli bir çalışmaya göre kullanıcıların yalnızca yüzde sekizi yapay zekadan aldığı yanıtları kontrol ediyor.

Bir başka deneyde ise katılımcıların yaklaşık yüzde sekseni, cevabın yanlış olduğu söylenmesine rağmen yapay zekanın görüşüne uymaya devam etti. Araştırmacılar bu olguyu “bilişsel teslimiyet” olarak nitelendiriyor.

Büyük dil modellerinin özgüvenli ve otoriter bir üslupla yanıt vermesi, yanlış bilgilerin doğruymuş izlenimi uyandırmasını kolaylaştırıyor. Google özetlerinin sunduğu hız ve pratiklik ise bu etkiyi pekiştiriyor.

Uzmanlar, AI Overview gibi araçların en azından kısa vadede temkinle kullanılması gerektiği uyarısını yapıyor.

Daha fazla kültür-sanat içeriği için bizi sosyal medya adreslerimizden takip edin!

Instagram'da @siyahdergicom,

Twitter'da @siyahdergi

ve TikTok'ta @siyahdergicom ♥

İçerikleri URL ile kaynak gösterip kısmen kullanabilirsiniz. Aksi halde telif haklarımız bulunmaktadır.

Yorum yaz